Processo contro Trump

Disinformazione generata: Cohen, ex avvocato di Trump, ha ammesso in tribunale l'uso improprio dell'intelligenza artificiale

Michael Cohen (M), ex avvocato dell'ex presidente degli Stati Uniti Trump, ammette di utilizzare l'intelligenza artificiale per generare informazioni false e trasmetterle ai suoi avvocati. (Archivio)

© Fonte: Stefan Jeremiah/FR171756 AP/AP

New York. L'ex avvocato di Trump, Michael Cohen, ha ammesso in tribunale di aver utilizzato l'intelligenza artificiale per generare informazioni false e trasmetterle ai suoi avvocati. Il 57enne ha utilizzato il chatbot di Google Bard per trovare documenti relativi a una causa legale di New York rilevati dal programma. Ciò risulta dai documenti appena rilasciati dal tribunale federale di Manhattan in cui Cohen giustifica il suo comportamento.

Leggi di più dopo l'annuncio

Leggi di più dopo l'annuncio

Cohen ammette i suoi errori

Cohen ha detto alla corte in una dichiarazione giurata rilasciata venerdì di non essere a conoscenza del fatto che Google Bard fosse un generatore di script simile a ChatGPT. Cohen ha ammesso il suo errore dopo che il giudice del caso ha chiesto spiegazioni per un totale di tre questioni menzionate, che non è riuscito a trovare.

Leggi di più dopo l'annuncio

Leggi di più dopo l'annuncio

Cohen si è dichiarato colpevole di violazioni riguardanti l’uso di donazioni a favore della campagna Trump nel 2018 ed è stato condannato a tre anni di carcere, ma gli è stato concesso di scontare parte della pena agli arresti domiciliari a causa della pandemia di coronavirus. Ora sono state trovate informazioni errate nella richiesta di Cohen alla corte di archiviare il caso.

È stato valutato più volte come inaffidabile durante il processo

Resta da vedere se questo incidente avrà qualche impatto sul processo attualmente in corso contro l’ex presidente Donald Trump. Cohen ha testimoniato come testimone chiave e la difesa di Trump lo ha ripetutamente descritto come inaffidabile.

I nuovi programmi di intelligenza artificiale hanno enormi capacità, ma il modo in cui sono programmati li rende vulnerabili alle “allucinazioni” di presunte realtà. Anche prima di Cohen, c’erano casi di avvocati che volevano semplificare il proprio lavoro utilizzando chatbot basati sull’intelligenza artificiale, ma finivano per fornire informazioni errate.

Rnd/dpa

“Fanatico della musica. Risolutore di problemi professionale. Lettore. Ninja televisivo pluripremiato.”

/cloudfront-eu-central-1.images.arcpublishing.com/madsack/D5NVBKL3C5HT7PJZYGD4KLMQTI.jpeg)

More Stories

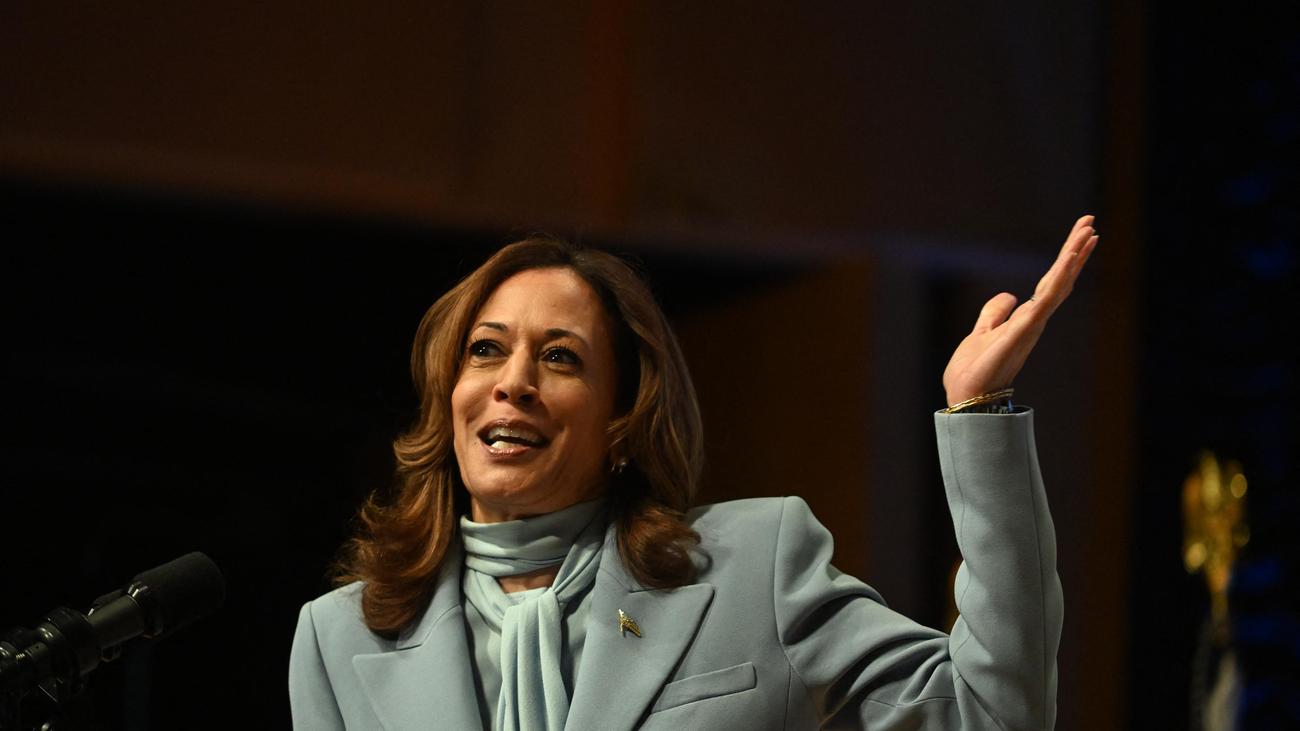

Sondaggio elettorale statunitense: Kamala Harris guida Donald Trump in due stati chiave

Ancora morti e feriti nelle esplosioni in Libano

L’Ucraina attacca la base dei bombardieri nucleari di Putin